获取优惠价格

18790282122spark机器学习

Spark机器学习:MLlib

本章主要介绍Spark的机器学习套件MLlib。MLlib从功能上说与ScikitLearn等机器学习库非常类似,但计算引擎采用的是Spark,即所有计算过程均实现了分布式,这也是它和其他机器学习库较大的不同。但读者在学习MLlibSpark Machine Learning (SparkML):机器学习 (部分一) 机器学习是现阶段实现人工智能应用的主要方法,它广泛应用于 机器视觉 、语音识别、自然语言处理、数据挖掘等领域。 MLlib是Apache Spark的可伸缩机器学习库。 官网 [ spark apache/docs/latest/mlguidehtml] SparkSpark Machine Learning(SparkML):机器学习(部分一

Spark从入门到精通(13):使用 MLlib 进行机器学习(上

Spark有两个机器学习包:sparkmllib和sparkml。sparkmllib是基于RDD API(从Spark 20开始处于维护模式)的原始机器学习API,而sparkml是基于DataFrames的较新API。本章的其余部分将重点介绍sparkml如何使用该软件包以及如何在Spark中设计机器 在介绍Spark MLlib的分布式机器学习训练方法之前,让我们先回顾一下Spark的分布式计算原理,这是分布式机器学习的基础。Spark,是一个分布式的计算平台。所谓分布式,指的是计算节点之间不共享内存,需要通过网络通信的方式交换数据。分布式机器学习之——Spark MLlib并行训练原理

基于Spark的分布式数据处理和机器学习技术上进小菜猪大

Spark提供了一种高效、可扩展的方式来处理和分析大规模数据集,并且支持广泛的数据处理任务和机器学习算法。 imagepng 2 Spark的基本概念和架构 Spark是一个基于内存的分布式计算框架,它以弹性的方式处理数据,并在内存中进行计算,从而大大提高了处理速度。 Spark的核心概念是弹性分布式数据集(Resilient Distributed Dataset,简 MLlib是Spark里的机器学习库。 它的目标是使实用的机器学习算法可扩展并容易使用。 它提供如下工具: 1机器学习算法:常规机器学习算法包括分类、回归、聚类和协同过滤。 2特征工程:特征提取、特征转换、特征选择以及降维。 3管道:构造、评估和Spark机器学习库(MLlib)中文指南

基于spark的深度学习怎么实现,具体应用实例?

在机器学习(MLlib)、数据查询(Spark SQL)、图形分析(GraphX)以及流运行(Spark Streaming )等模块的共同支持下,开发人员能够以无缝化方式使用来自任意单一应用程序的库。举例来说,开发人员可以根据HDFS当中的某个文件创建一个RDD,将 Spark可以被用来机器学习,下面是机器学习的基本流程,包括数据收集、清洗,特征工程,模型训练,模型评估,模型预测,甚至模型管理与部署。 Spark MLlib提供2套使用不同数据结构的package来支持machine learning, 其中orgapachesparkml提供DataFrames的接口,而orgapachesparkmllib提供RDD接口,后者处于维护阶段,不添 Spark Machine Learning

MLlib: Main Guide Spark 350 Documentation Apache Spark

MLlib is Spark’s machine learning (ML) library Its goal is to make practical machine learning scalable and easy At a high level, it provides tools such as: ML Algorithms: common learning algorithms such as classification, regression, clustering, and collaborative filteringSpark 的内存中分布式计算功能使其成为机器学习和图形计算中使用的迭代算法的最佳选择。 sparkml 提供了一组统一的高级 API,可帮助用户创建和优化机器学习管道。若要详细了解 sparkml,可以访问 Apache Spark ML 编程指南。 Azure 机器学习自动化 使用 Apache Spark 进行机器学习 Azure Synapse Analytics

Spark机器学习:MLlib

本章主要介绍Spark的机器学习套件MLlib。MLlib从功能上说与ScikitLearn等机器学习库非常类似,但计算引擎采用的是Spark,即所有计算过程均实现了分布式,这也是它和其他机器学习库较大的不同。但读者在学习MLlibSpark Machine Learning (SparkML):机器学习 (部分一) 机器学习是现阶段实现人工智能应用的主要方法,它广泛应用于 机器视觉 、语音识别、自然语言处理、数据挖掘等领域。 MLlib是Apache Spark的可伸缩机器学习库。 官网 [ spark apache/docs/latest/mlguidehtml] SparkSpark Machine Learning(SparkML):机器学习(部分一

Spark从入门到精通(13):使用 MLlib 进行机器学习(上

Spark有两个机器学习包:sparkmllib和sparkml。sparkmllib是基于RDD API(从Spark 20开始处于维护模式)的原始机器学习API,而sparkml是基于DataFrames的较新API。本章的其余部分将重点介绍sparkml如何使用该软件包以及如何在Spark中设计机器 在介绍Spark MLlib的分布式机器学习训练方法之前,让我们先回顾一下Spark的分布式计算原理,这是分布式机器学习的基础。Spark,是一个分布式的计算平台。所谓分布式,指的是计算节点之间不共享内存,需要通过网络通信的方式交换数据。分布式机器学习之——Spark MLlib并行训练原理

基于Spark的分布式数据处理和机器学习技术上进小菜猪大

Spark提供了一种高效、可扩展的方式来处理和分析大规模数据集,并且支持广泛的数据处理任务和机器学习算法。 imagepng 2 Spark的基本概念和架构 Spark是一个基于内存的分布式计算框架,它以弹性的方式处理数据,并在内存中进行计算,从而大大提高了处理速度。 Spark的核心概念是弹性分布式数据集(Resilient Distributed Dataset,简 MLlib是Spark里的机器学习库。 它的目标是使实用的机器学习算法可扩展并容易使用。 它提供如下工具: 1机器学习算法:常规机器学习算法包括分类、回归、聚类和协同过滤。 2特征工程:特征提取、特征转换、特征选择以及降维。 3管道:构造、评估和Spark机器学习库(MLlib)中文指南

基于spark的深度学习怎么实现,具体应用实例?

在机器学习(MLlib)、数据查询(Spark SQL)、图形分析(GraphX)以及流运行(Spark Streaming )等模块的共同支持下,开发人员能够以无缝化方式使用来自任意单一应用程序的库。举例来说,开发人员可以根据HDFS当中的某个文件创建一个RDD,将 Spark可以被用来机器学习,下面是机器学习的基本流程,包括数据收集、清洗,特征工程,模型训练,模型评估,模型预测,甚至模型管理与部署。 Spark MLlib提供2套使用不同数据结构的package来支持machine learning, 其中orgapachesparkml提供DataFrames的接口,而orgapachesparkmllib提供RDD接口,后者处于维护阶段,不添 Spark Machine Learning

MLlib: Main Guide Spark 350 Documentation Apache Spark

MLlib is Spark’s machine learning (ML) library Its goal is to make practical machine learning scalable and easy At a high level, it provides tools such as: ML Algorithms: common learning algorithms such as classification, regression, clustering, and collaborative filteringSpark 的内存中分布式计算功能使其成为机器学习和图形计算中使用的迭代算法的最佳选择。 sparkml 提供了一组统一的高级 API,可帮助用户创建和优化机器学习管道。若要详细了解 sparkml,可以访问 Apache Spark ML 编程指南。 Azure 机器学习自动化 使用 Apache Spark 进行机器学习 Azure Synapse Analytics

- 喷金钢砂的喷头哪里卖

- 5ehc破碎机

- 搅拌站粉料砂石料误差值

- 移动式反击破碎站产量2000TH

- 每小时产100T颚式粉碎机

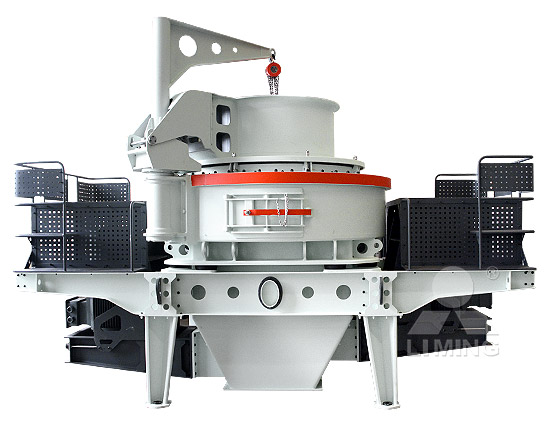

- 新一代制砂机配件厂家

- 蛋鸡用石粉粒径

- 时产950方硬玉破沙机

- 新好景嘉达石场

- 矿粉机器产量250TH

- 山石粉碎工序

- jc欧版鄂破机

- 石墨颗粒建筑材料生产工艺及所用设备

- 弱磁选机操作

- 石膏隔墙生产设备

- 浙江石材加工机械

- cs矿山机械

- 天然碎石含粉量

- 时产230方石灰石冲击破制砂机

- 石材工艺加工厂

- 螺旋上料机总是堵塞

- 井下破碎机使用

- 做腻子粉生产线多少钱

- 广元硅石砂破碎机械厂家

- 铁矿砂干吨和湿吨的区别和标准

- 100目磨细设备

- 锤式破碎机PLM

- 青岛煤辉矿山设备有限公司

- 碎石加工场要求

- 黄红丹中速粉石子机